Portada »

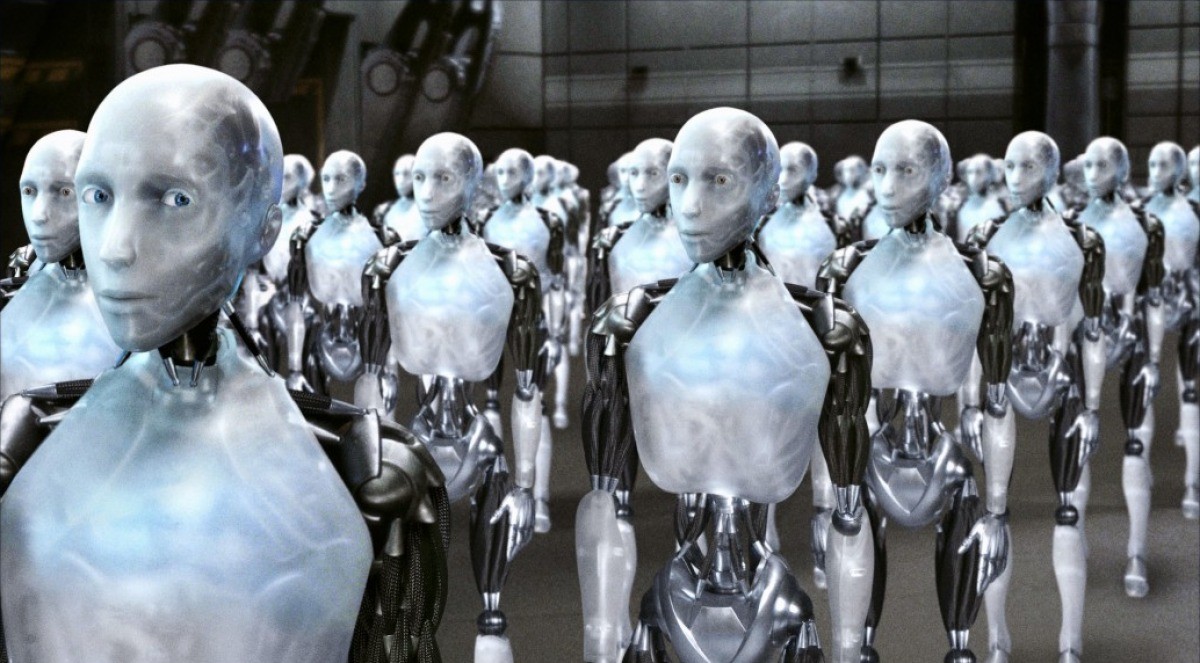

Las 3 leyes de la robótica, y su relevancia en la era de la IA

🕒 Lectura estimada: 5 min

La inteligencia artificial está en todas partes, y las leyes de la robótica, ahora toman mas relevancia que nunca

Portada »

🕒 Lectura estimada: 5 min

La inteligencia artificial está en todas partes, y las leyes de la robótica, ahora toman mas relevancia que nunca

La inteligencia artificial está en todas partes: hace textos, genera imágenes, responde preguntas e incluso toma decisiones que antes solo correspondían a los humanos. Pero esta revolución tecnológica no es nueva en absoluto.

Hace más de 80 años, un escritor imaginó el problema que hoy preocupa al mundo: ¿cómo evitar que las máquinas dañen a los humanos?

Hablamos de Isaac Asimov, y su respuesta fueron las famosas Tres Leyes de la Robótica, un conjunto de reglas diseñadas para garantizar que los robots vivieran de forma segura con la humanidad. Lo sorprendente es que, en plena era de ChatGPT, robots autónomos y sistemas inteligentes, estas leyes vuelven a ser más relevantes que nunca.

Las Tres Leyes aparecieron por primera vez en 1942 en el relato Runaround, escrito por el autor ruso-estadounidense Isaac Asimov. A diferencia de otras historias de ciencia ficción donde los robots se rebelaban contra sus creadores.

Asimov imaginó un mundo donde las máquinas estaban programadas para proteger a los humanos.

Su objetivo no era solo crear ficción, sino explorar cómo la lógica, la ética y la programación podían coexistir.

Estas son las tres leyes de la robótica:

“Un robot no puede dañar a un ser humano ni, por inacción, permitir que un ser humano sufra daño.”

Esta es la ley más importante. Significa que la prioridad absoluta de cualquier robot debe ser la seguridad humana.

En el contexto actual, esta idea se relaciona directamente con el desarrollo de sistemas de inteligencia artificial seguros. Empresas como OpenAI, Google y Microsoft trabajan activamente en lo que se conoce como IA alineada, es decir, sistemas diseñados para beneficiar a las personas y no perjudicarlas.

“Un robot debe obedecer las órdenes dadas por los seres humanos, excepto si estas órdenes entran en conflicto con la Primera Ley.”

Esto implica que los robots deben actuar como asistentes, no como entidades independientes con voluntad propia.

Hoy, los asistentes virtuales, chatbots y sistemas de automatización funcionan bajo este mismo principio. Responden a instrucciones humanas, pero incluyen restricciones para evitar usos peligrosos o dañinos.

Por ejemplo, los sistemas modernos no pueden ayudar a crear contenido ilegal o peligroso.

“Un robot debe proteger su propia existencia, siempre que esta protección no entre en conflicto con la Primera o la Segunda Ley.”

Esta ley introduce el concepto de autopreservación, pero subordinado a la seguridad humana.

En la IA moderna, esto se refleja en sistemas que buscan estabilidad operativa, evitan fallos críticos y mantienen su funcionamiento, siempre dentro de parámetros seguros.

Años después, Asimov añadió una cuarta regla, conocida como la Ley Cero:

“Un robot no puede dañar a la humanidad ni, por inacción, permitir que la humanidad sufra daño.”

Esta ley eleva el debate a un nivel más complejo: proteger a la humanidad en general, incluso si eso implica decisiones difíciles.

Este concepto se parece mucho a los debates actuales sobre IA avanzada, donde se discuten temas como:

Aunque las leyes de Asimov son ficción, inspiraron profundamente la forma en que hoy se diseñan sistemas inteligentes.

Actualmente, los desarrolladores trabajan en:

El objetivo es evitar escenarios donde la inteligencia artificial actúe de forma perjudicial o fuera de control.

Sin embargo, a diferencia de las historias de ciencia ficción, las leyes no están literalmente programadas en las IA modernas. En su lugar, se utilizan principios éticos, normas legales y sistemas de seguridad más complejos.

La diferencia clave entre los robots de Asimov y la IA actual es que los sistemas modernos pueden aprender, adaptarse y evolucionar.

Esto plantea preguntas fundamentales:

Estas preguntas están en el centro del desarrollo tecnológico actual.

A pesar de los temores populares, los expertos coinciden en que el mayor riesgo de la IA no es una rebelión tipo Terminator, sino su uso irresponsable o mal diseñado.

Las Tres Leyes de la Robótica siguen siendo relevantes no porque se apliquen literalmente, sino porque representan un principio fundamental: la tecnología debe estar al servicio de la humanidad, no al revés.

Y en un mundo donde la inteligencia artificial crece cada día, esa idea es más importante que nunca.

LEA TAMBIEN: OpenAI reacciona: nuevas medidas en ChatGPT ante suicidio adolescente

james

Recibe noticias, análisis y contenido geek directo en tu bandeja.

Deja tu comentario